Wenn Roboter Chirurg*innen unterstützen

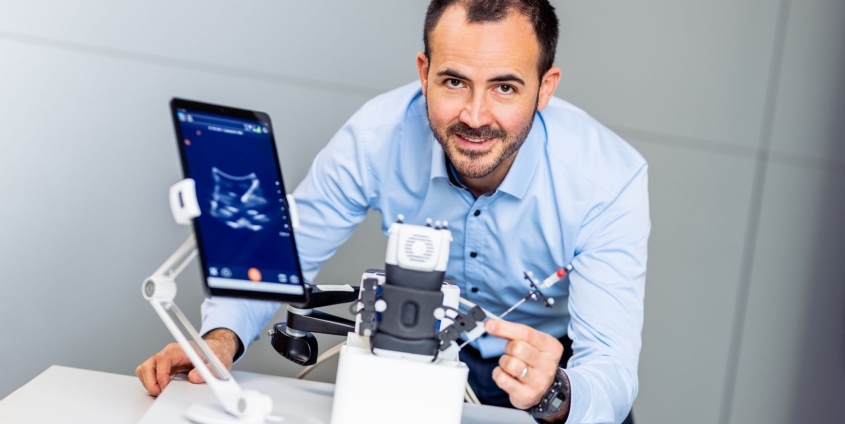

Robotersysteme sind heute nur Assistenten zum Halten und Zielen von Operationswerkzeugen. Ein Forschungsteam rund um Jan Steinbrener und Stephan Weiss an der Universität Klagenfurt möchte nun an neuen technologischen Möglichkeiten arbeiten, die die Chirurg*in bei ihrer Arbeit unterstützen sollen.

Minimalinvasive Operationen, die mit einem nur knopflochgroßen Schnitt durchgeführt werden, haben viele Vorteile. Sie erzeugen weniger Komplikationen nach der Operation, werden von Patient*innen besser akzeptiert und sind kosteneffizienter. Ein Nachteil ist aber, dass die Chirurg*in ihre Geräte nicht mit den eigenen Augen durch das Körperinnere lotsen kann, sondern dabei auf externe Bildgebungsgeräte angewiesen ist, die ihr zeigen, wo sie gerade arbeitet. Für Jan Steinbrener, der am Institut für Intelligente Systemtechnologien in der Gruppe Control of Networked Systems forscht und lehrt, muss ein unterstützender Roboter also zuerst folgende Fragen beantworten können: „Wo genau bin ich? Wo möchte ich hin?“

Was philosophisch anmutet, sei technisch gar nicht so einfach umzusetzen, so Steinbrener weiter: „Stellen wir uns eine Operation an Weichteilstellen vor. Allein durch die Atmung ist das Gewebe ständig in Bewegung. Außerdem sehen wir nicht alle im Körperinneren gleich aus, sondern Verformungen können Zielregionen verschieben oder den Blick auf den weiteren ‚Weg‘ verstellen.“ Diese Aufgabe ist selbst für menschliche Operateur*innen nicht leicht zu bewältigen, müssen sie doch laufend interpretieren, was via Kamera auf einen Bildschirm übertragen wird. In Zukunft soll aber ein Roboter bei der „Zustandsschätzung“ (also genau bei dieser Positionierung) unterstützen. Das Forschungsteam greift dabei auf Erkenntnisse aus der Drohnenforschung zurück.

„Wir haben hier aber eine andere bildgebende Modalität. Wenn eine Drohne sich selbst mithilfe von Objekten am Boden verorten soll, kann man sich mit geometrischen Ansätzen behelfen. Anhand von Fixpunkten im Bild, das die Kamera aufnimmt, und beispielsweise dem Abstand zum Objekt kann sich die Drohne positionieren. Im Körperinneren haben wir aber weniger klar abgrenzbare Formen. Diese sind zudem ständig in Bewegung“, erläutert Jan Steinbrener, der das Projekt gemeinsam mit Stephan Weiss leitet. Ziel ist es, mithilfe von KI-Methoden einen Lernalgorithmus so zu trainieren, damit dieser schließlich eine verlässliche Zustandsschätzung ermöglicht.

„Algorithmen sind aber noch häufig eine Blackbox: Man weiß also nur bedingt, warum sie funktionieren, wann sie nicht funktionieren und wie sicher sie funktionieren.“

(Jan Steinbrener)

Im Alltag bedeutet dieses Projekt für Jan Steinbrener und seine Kolleg*innen viel Arbeit am PC, aber auch in experimentellen Settings: „Wir nutzen auch die Infrarot-Tracking-Kameras in unserer Drohnenhalle, um die Bewegungen des Werkzeugs, das vom Roboter geführt wird, aufnehmen zu können. Wir wollen ganz genau wissen, wo das Operationswerkzeug war, um in der Folge unsere Algorithmen trainieren zu können.“ In Summe will man das Ziel einer „autonomeren“ Unterstützung für Chirurg*innen erreichen, wobei dem eigenständigen Handeln der Roboter nicht nur aus ethischen und rechtlich-regulatorischen Gründen noch große Schranken gesetzt sind: „Uns fehlen auch noch viele technische Lösungen: künstliche Intelligenz, damit Bilder und potenzielle Bildfehler richtig interpretiert werden und Algorithmen zur modularen Multisensorfusion, die die Daten aller Sensoren einschließlich ihrer Unsicherheiten zur Positionsbestimmung des chirurgischen Instruments im Körper verwenden können.“ Das Projekt mit dem Titel AIMRobot wird durch die Österreichische Forschungsförderungsgesellschaft FFG finanziert und gemeinsam mit dem Industriepartner iSYS Medizintechnik GmbH aus Wattens durchgeführt. Mit Ergebnissen rechnet das Team Mitte 2023.

Jan Steinbrener, der selbst eine große Affinität zur Medizin hat und sich dann doch für die Physik entschieden hat, war selbst fünf Jahre lang bei Siemens in der Medizinsparte tätig und hat dort Röntgengeräte mitentwickelt. Medizintechnische Innovationen bringen wesentliche Verbesserungen für Patient*innen. Steinbrener stellt dazu den Vergleich mit der kommerziellen Luftfahrt in den Raum: „In den 1960ern haben Pilot*innen die Maschinen noch alleine gesteuert; heute sind sie als Team Systemmanager*innen einer hochintelligenten Maschine. Insgesamt ist die Luftfahrt dadurch sehr viel sicherer geworden.“ Von einer Zukunftsvision mit alleine operierenden Robotern sei man noch meilenweit entfernt: „Manche Algorithmen können zwar beispielsweise in der Diagnostik ähnlich sensitiv und ähnlich spezifisch Krankheiten anhand von Bildern erkennen wie langjährige Spezialist*innen. Algorithmen sind aber noch häufig eine Blackbox: Man weiß also nur bedingt, warum sie funktionieren, wann sie nicht funktionieren und wie sicher sie funktionieren.“ Die Technik werde sich zwar in den nächsten Jahrzehnten rasant weiterentwickeln, letztlich gehe es aber darum, die optimale Performance im Sinne des Patienteninteresses zu erreichen. Unterstützende Roboter, die menschliche Operateur*innen auf potenzielle Fehler aufmerksam machen, könnten hier ein wichtiger Schritt sein, denn auch der Mensch sei anfällig für Fehler: „Auch Chirurg*innen haben mal schlechtere und bessere Tage.“

für ad astra: Romy Müller

Foto: Daniel Waschnig

Foto: Daniel Waschnig